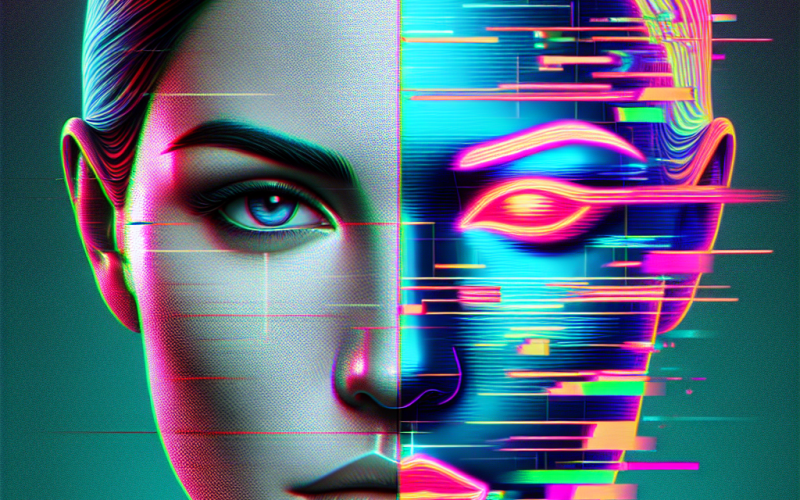

Eu curto tecnologia, mas quando a tecnologia começa a usar seu rosto como moeda, a gente tem que abrir o olho. Nos últimos meses fiquei obcecado com um ponto: vídeos e áudios gerados por IA — os chamados deepfakes — estão sendo usados em golpes e para destruir reputações. Deepfake é basicamente um conteúdo sintético que imita alguém (voz, rosto), criado por redes neurais. Simples assim, assustador na prática.

O que eu faço na prática

1) Verifico a fonte: se o vídeo apareceu do nada, desconfio.

2) Uso confirmação em duas etapas e protejo contas com senhas fortes.

3) Busco metadados e sinais: sincronização labial estranha, reflexos, piscadas fora do ritmo são pistas.

4) Arquivo minhas evidências — prints, links e timestamps — caso precise comprovar depois.

Na vida pessoal, isso me lembra delegar a alguém uma tarefa importante e descobrir que a pessoa usou atalhos sujos. A confiança demora a construir e é rápida pra quebrar. E fraude é fraude: roubo de identidade e manipulação mal-intencionada são claramente errados.

Moral: a tecnologia amplia possibilidades, mas também nossa responsabilidade. Não espere ser vítima para aprender a se proteger — eduque, denuncie e documente.

Fontes:

https://www.bbc.com/news/technology-51474791

https://www.nist.gov/itl/ssd/projects/deepfake-detection

https://www.europol.europa.eu/crime-areas-and-trends/crime-areas/cybercrime/deepfakes